约束可执行化:外部锚点作为LLM推理能力的结构性基础

摘要

LLM推理能力的本质是什么?本文提出"约束可执行化"框架,整合六个视角的实证研究,揭示LLM推理能力的结构性基础:外部锚点。当外部锚点存在且可执行时,LLM能够"导航"到正确答案;当外部锚点缺失时,推理能力无法涌现。外部锚点的实现形式是约束验证器,而开放式任务的困境可以通过动态约束系统部分解决。

引言:推理能力的悖论

推理型LLM(Reasoning LLM)的崛起令人瞩目。OpenAI的o3、DeepSeek R1等模型在数学竞赛、代码生成、复杂推理任务上的表现,似乎预示着AI已经掌握了"推理"。

但一个悖论随之浮现:同样的模型,在不同任务上的表现天差地别。

在数学和代码任务上,这些模型展现出惊人的能力;但在开放式任务(如"写一篇原创文章")上,它们却频频"反思幻觉"——流利地说出"我需要改进",却无法真正改进 [ref]。

传统的解释路径——推理时计算、思维链、强化学习——都无法解释这种任务依赖性。它们停留在"如何做"的层面,没有回答"为什么在某些任务上行得通,在其他任务上不行"。

本文提出一个统一的答案:推理能力不是通用能力,而是对外部锚点的结构性依赖。

外部锚点(External Anchor)是指可以用来校准模型输出的客观标准,如正确答案、代码执行结果、约束验证器。当外部锚点存在时,模型可以"看到"自己的错误并修正;当外部锚点缺失时,模型陷入"无的放矢"的困境。

本文将系统论证这一论断,并提出外部锚点的实现形式:约束验证器。我们将展示,从DeepSeek R1的成功到"Illusions of Reflection"的失败,都可以用这一框架统一解释。

六视角框架:向外部锚点收敛

视角一:BRAC框架——事件文件不完整

BRAC(Binding and Retrieval in Action Control)是认知心理学中的行动控制框架,由 Frings et al. (2020) 提出 [ref]。该框架揭示了人类行动控制的核心机制:特征绑定(Feature Binding)和特征检索(Feature Retrieval)。研究发现,当刺激、反应和效果特征被整合到"事件文件"中时,人类能够实现目标导向的行为控制。

关键洞察:缺少"效果"意味着缺少反馈信号,即缺少外部锚点。Foerster et al. (2022) 进一步发现,控制状态本身可以被绑定和检索——错误诱发的控制状态被嵌入到事件文件中 [ref]。没有外部锚点,控制状态无处嵌入,反思就变成了"无的放矢"。

视角二:mPCAB框架——外部约束不内化

mPCAB(model-based Policy with Constraint-Aware Behavior)研究如何将外部约束内化到模型行为中 [ref]。研究发现,即使在训练时有外部约束,模型在分布偏移时仍然会失效。

关键洞察:外部约束没有被真正"内化",只是被"记忆"为训练数据的模式。当面对新情况时,没有外部锚点实时检查,约束就会失效。

视角三:CorrectBench——自我修正的条件性

CorrectBench研究发现,DeepSeek-V3在封闭式任务上表现出较强的"内置修正机制",但在开放式任务上这种机制失效 [ref]。

关键洞察:CorrectBench使用的是封闭式任务(有外部锚点:单元测试、正确答案),而开放式任务(无外部锚点)上,修正机制完全失效。这暗示"修正能力"不是通用的,而是依赖于外部锚点。

视角四:Illusions of Reflection——反思幻觉

Illusions of Reflection(arXiv 2510.18254)的研究给出了最直接的证据 [ref]:

| 指标 | 数据 |

|---|---|

| 反思时重复同一错误 | 85.36%(高于随机基准74.69%) |

| 推理型LLM vs 普通模型 | 无优势(β=-0.075) |

| "改进"的本质 | 第二次尝试的偶然成功 |

图:H1假设验证。Panel A展示反思前后的session pass-rate分布;Panel B展示配对差异的分布。虽然反思显著提升了pass-rate,但提升主要来自第二次尝试的偶然成功。

研究使用的是开放式任务(如"写一篇文章,不要抄袭"),发现推理型LLM(o3, o4-mini, DeepSeek Reasoner)没有优势。模型能说"不要抄袭"(流利的自我批判),但仍然抄袭(约束绑定失败)。

关键洞察:开放式任务的困境在于缺乏外部锚点。"反思能力"是幻觉——模型只是在生成符合语言习惯的反思文本,但没有能力修正行为。

图:H1b假设验证——反思时重复原始错误的概率高于随机基准。Panel A显示观察到的错误重复率(85.36%)显著高于置换基准(74.69%);Panel B展示最常见的五种错误类别的重复情况。这表明"改进"并非来自真正的错误检测和修正。

视角五:DeepSeek R1——推理能力=对外部锚点的响应

DeepSeek R1(arXiv 2501.12948)的研究提供了正面证据 [ref]:

1 | 奖励系统: |

关键发现:蒸馏 > RL。DeepSeek-R1-Distill-Qwen-32B(72.6%)远超RL训练的模型(47%)。推理模式可以被"复制",但不能被小模型"发现"。

关键洞察:推理能力的涌现依赖于外部锚点(准确性奖励)。没有外部锚点,RL训练无法有效进行;有外部锚点,模型能学习到"推理模式"。

视角六:RECAST与ACT——约束可执行化

RECAST(arXiv 2505.19030v2)和ACT(arXiv 2403.06326v1)的研究提供了外部锚点的具体实现形式 [ref] [ref]。

RECAST将约束分为两类:

| 约束类型 | 验证方式 | 示例 |

|---|---|---|

| Rule-based | 程序化验证 | 长度限制、关键词包含/排除、段落数量 |

| Model-based | LLM语义判断 | 风格一致性、语气、说服力 |

每个约束都有对应的约束验证器(Constraint Verifier):f(x, y, c_i) → {0, 1},返回约束是否被满足。

图:RECAST框架概览。RLVC(Reinforcement Learning from Verifiable Constraints)将约束验证结果作为奖励信号。左上:复杂指令通常包含多个约束;右上:约束验证器将约束验证结果转化为可验证奖励;下方:验证器可以是Rule-based或Model-based [ref]。

RECAST的RLVC框架将约束验证结果作为奖励信号:

1 | R(x,y) = (1/|C|) Σ f(x,y,c_i) |

关键结果:

- 平均每个指令包含13.4个约束

- Qwen2.5-7B用RECAST-30K训练后,超越同模型的Instruct版本

关键洞察:约束验证器就是外部锚点的具体实现形式。从抽象的"外部锚点"概念,到具体的"约束验证器",我们看到了可操作的实现路径。

六视角统一

| 视角 | 发现 | 共同指向 |

|---|---|---|

| BRAC | 缺少"效果"→事件文件不完整 | 外部锚点缺失 |

| mPCAB | 外部约束不内化→分布偏移时失效 | 外部锚点缺失 |

| CorrectBench | 无外部验证→自我修正可能失效 | 外部锚点缺失 |

| Illusions of Reflection | 开放式任务→约束绑定失败 | 外部锚点缺失 |

| DeepSeek R1 | 准确性奖励→推理能力涌现 | 外部锚点响应 |

| RECAST/ACT | 约束验证器→程序化验证约束 | 外部锚点实现 |

统一结论:

- 推理型LLM的"推理"是对外部锚点的响应,不是内在的约束绑定能力

- 有外部锚点时,模型能"导航"到正确答案

- 无外部锚点时,模型无法自主绑定约束

约束可执行化:从理论到实践

什么是约束可执行化?

**约束可执行化(Constraint Executability)**是指将自然语言表述的约束,转化为可程序化验证的检查机制的过程。

从模糊约束到可执行验证器的转化:

1 | 开放式约束 可执行验证器 |

约束验证器的层次

根据约束的性质,验证器可以分为三个层次:

| 层次 | 验证方式 | 可靠性 |

|---|---|---|

| 可程序化验证 | 规则引擎、代码执行 | 高 |

| 需语义理解 | LLM判断、相似度检测 | 中 |

| 主观判断 | 人类评估 | 低 |

关键发现:约束验证器的可靠性与任务的"可验证性"直接相关。可程序化验证的约束验证器提供了最可靠的外部锚点。

约束可执行化的实现路径

基于RECAST和ACT的实证研究,约束可执行化的实现路径如下:

步骤1:约束识别

- 从用户指令中显式提取约束

- 将隐式约束转化为显式约束

- 区分Rule-based和Model-based约束

步骤2:验证器设计

- 为每个约束设计验证函数

- Rule-based:规则引擎、正则表达式、代码执行

- Model-based:LLM判断、相似度检测、分类器

步骤3:奖励机制

- 将验证结果作为奖励信号

- 使用强化学习(如GRPO)优化模型

- 每个约束作为独立的优化目标

步骤4:训练或推理时应用

- 训练时:用约束验证结果生成偏好数据

- 推理时:用验证器筛选或修正输出

实践案例:DeepSeek R1的成功解释

DeepSeek R1的成功可以用约束可执行化框架重新解读:

数学任务:

- 约束:“答案正确”

- 验证器:对比计算结果与标准答案

- 奖励:准确性奖励

- 结果:推理能力涌现

代码任务:

- 约束:“代码可运行且通过测试”

- 验证器:执行代码,检查测试用例

- 奖励:执行成功奖励

- 结果:代码生成能力提升

开放式任务(如写作):

- 约束:“不要抄袭”——如何验证?

- 验证器:?难以设计可靠的验证器

- 奖励:?缺乏可靠的奖励信号

- 结果:能力提升有限

关键洞察:DeepSeek R1的成功在于选择了约束可执行化的任务。对于无法可执行化的任务(如开放式写作),推理能力无法涌现。

开放式任务的困境与突破

开放式任务的本质困境

开放式任务(Open-Ended Task)是指没有唯一正确答案的任务,如写作、创意设计、理论研究。

开放式任务的困境:

1 | 困境的本质: |

Illusions of Reflection论文的开放式任务就是典型案例:

- 约束:“不要抄袭”——如何定义"抄袭"?

- 约束:“原创”——如何验证"原创性"?

- 约束:“有价值”——价值由谁判断?

部分约束可执行化

虽然开放式任务无法完全可执行化,但可以部分可执行化:

| 约束类型 | 可执行化程度 | 示例 |

|---|---|---|

| 格式约束 | 完全可执行化 | 字数、段落、标题结构 |

| 事实约束 | 部分可执行化 | 引用验证、事实核查 |

| 风格约束 | 部分可执行化 | 相似度检测、风格分类 |

| 价值约束 | 难以可执行化 | “有意义”、“有价值” |

策略:尽可能将约束可执行化,对于无法可执行化的部分,承认其不确定性。

内部锚点的可能性

RECAST的一个启示:约束验证器可以是Model-based的。这暗示了一种可能性——内部锚点。

内部锚点是指模型自己生成的验证标准。例如:

- 模型生成自己的约束清单

- 模型设计自己的验证逻辑

- 模型评估自己的输出

但内部锚点面临循环验证困境:

1 | 模型生成约束 → 谁验证约束的合理性? |

批判性判断:内部锚点的可能性存在,但目前仍处于理论探索阶段。RECAST的Model-based验证器仍然依赖外部训练的LLM,不是真正的"内部锚点"。

动态约束系统的突破:对抗训练作为实现路径

动态约束系统的核心思想是:约束可以在对抗性交互中涌现和进化。

实证案例:创意写作的对抗训练

最新研究"Igniting Creative Writing in Small Language Models" [ref] 展示了一个成功的动态约束系统:

1 | Generator: 生成"坏"问候语,试图欺骗 Detector |

动态约束的实现机制:

| 维度 | 实现 |

|---|---|

| 约束涌现 | Generator 不断生成更隐蔽的"坏"样本 |

| 验证器进化 | Detector 被迫学习更精细的判断标准 |

| 稳定机制 | Reflector 提供真实标签作为外部锚点 |

关键结果:

- LLM-as-a-Judge + RL 优秀率达到 92.4%(高频问候)

- 超过 GPT-4o(49%)、DeepSeek-V3(91%)

- 优于 Multi-Agent RM 方法

动态约束 vs 静态约束的对比:

| 维度 | 静态约束 | 动态约束 |

|---|---|---|

| 评估标准 | 固定(答案、规则) | 进化(对抗训练) |

| 适用任务 | 封闭式(数学、代码) | 开放式(写作、创意) |

| 稳定机制 | 直接验证 | 外部锚点(真实标签) |

动态约束的通用范式:

动态约束的本质不是"对手",而是对抗性交互让评估标准持续进化。

| 对抗形式 | 应用领域 | 约束进化方式 | 稳定机制 | 博弈性质 |

|---|---|---|---|---|

| Self-play | 游戏训练(SPIRAL) | 对手策略进化 | RAE(EMA baseline) | 零和 + 技术稳定 |

| Generator-Evaluator | 代码推理(SInQ) | 语义理解进化 | Positive-sum 设计 | 正和博弈 |

| Generator-Detector | 创意写作 | 判断标准进化 | Reflector(真实标签) | 协作博弈 |

| Proposer-Solver | 代码生成(PSV) | 问题难度进化 | 形式化验证 | 难度匹配 |

| Solver-Verifier | 代码+测试生成(Sol-Ver) | 能力协同进化 | 执行反馈 | 协同进化 |

| Self-Iterative | 代码效率优化(Afterburner) | 效率阈值提升 | Monolith沙箱 | 自我迭代 |

零和博弈的不稳定性问题:

最新研究发现,纯对抗性零和博弈在LLM训练中存在根本性问题 [ref] [ref]:

| 问题 | 表现 | 根本原因 |

|---|---|---|

| Thinking Collapse | 推理轨迹从2000字符暴跌至0 | 同一模型学习对立目标,梯度信号混乱 |

| 不可能问题 | Attacker创建密码学级别的难题 | Zero-sum激励创建最难题目,不考虑可解性 |

两种稳定机制的设计哲学:

| 方案 | 代表 | 稳定层面 | 核心思想 |

|---|---|---|---|

| 技术稳定 | SPIRAL RAE | 保持零和博弈 | 角色条件化baseline减少方差 |

| 设计稳定 | SInQ Positive-sum | 改变博弈性质 | 目标难度<最大值,转为教师-学生关系 |

SInQ的关键设计:将目标难度从最大值(10)降低到中等(如7),博弈从零和转为正和。Generator不再试图"打败"Evaluator,而是成为"教师",创建"难但可解"的问题 [ref]。

共同模式:对抗性训练需要稳定机制。零和博弈要么通过技术手段稳定(RAE),要么通过设计转型为正和博弈(Positive-sum)。

稳定机制的重要性:

与 SPIRAL 的 RAE 机制类似,动态约束需要外部锚点来稳定:

| 系统 | 不稳定问题 | 稳定机制 | 稳定类型 |

|---|---|---|---|

| SPIRAL | Thinking Collapse | RAE(EMA baseline) | 技术 |

| SInQ | 不可能问题 | Positive-sum 设计 | 设计 |

| 创意写作对抗 | 对抗训练偏离 | Reflector(真实标签) | 外部锚点 |

| PSV | 问题过难/过易 | Difficulty-aware Proposer | 设计 |

| Sol-Ver | 测试质量不足 | Solver-Verifier协同进化 | 协作本质 |

| Afterburner | 效率提升饱和 | Monolith执行反馈 | 外部锚点 |

共同模式:对抗性训练需要外部锚点来稳定。

图:SPIRAL框架。模型通过自我对弈发现和优化推理策略,无需人工设计奖励。RAE(Reward Anchored Estimation)机制解决了零和博弈中的Thinking Collapse问题 [ref]。

这为开放式任务提供了新的解决路径:通过对抗训练构建动态约束系统,同时用外部锚点保持稳定。

代码生成领域的动态约束实证

最新研究为代码生成领域的动态约束提供了三组实证案例:

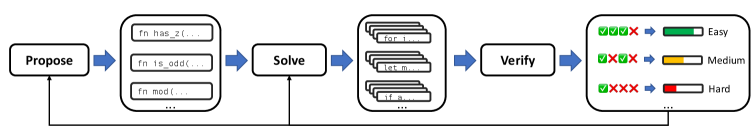

案例1:PSV(Propose, Solve, Verify)——形式化验证的自博弈

图:PSV框架。通过形式化验证(Formal Verification)实现自博弈。Proposer生成新问题规范,Solver生成代码+证明,Verifier通过形式化验证确保正确性。Pass rate作为难度估计指导问题生成 [ref]。

PSV使用形式化验证(Formal Verification)作为约束验证器 [ref]:

1 | Proposer: 根据难度标签生成新的问题规范 |

关键优势:

- 形式化验证是 Sound 的——验证通过 = 保证正确

- 消除了 Reward Hacking 问题

- Proposer 根据 pass rate 动态调整问题难度

实验结果:

- Dafny2Verus Pass@1: 24.06% → 65.63%(+172%)

- MBPP Pass@1: 6.48% → 36.78%(+468%)

动态约束机制:

| 维度 | 实现 |

|---|---|

| 难度估计 | Pass rate 分类为 Easy/Medium/Hard/Impossible |

| 问题生成 | 根据难度标签生成对应难度的问题 |

| 稳定机制 | 形式化验证提供 Sound 约束验证 |

案例2:Sol-Ver——单元测试验证的协同进化

图:Sol-Ver框架。LLM同时扮演Solver(代码生成)和Verifier(测试生成)角色。通过执行反馈构建偏好对,使用SFT和DPO迭代训练 [ref]。

Sol-Ver使用单元测试作为约束验证器 [ref]:

1 | Solver: 生成代码 |

关键发现:

- LLM 作为 Verifier(生成测试)的能力显著落后于作为 Solver(生成代码)

- MBPP 上:Test Pass Rate 18.6% vs Code Pass Rate 38.6%

- 通过自博弈可以同时提升两种能力

根本局限:

- 单元测试是 Unsound 的——可能漏测错误

- 存在 Reward Hacking 风险

博弈性质:协同进化——Solver和Verifier共同提升,而非对抗。

案例3:SInQ——语义不等价博弈的Positive-sum设计

图:SInQ语义不等价博弈。Alice接收程序P,生成不等价程序Q和分歧输入;Bob尝试找出分歧输入 [ref]。

SInQ使用程序执行作为约束验证器 [ref]:

1 | Generator (Alice): 创建语义不同的程序变体 Q + 提供区分输入 x |

关键创新:

- Positive-sum设计:目标难度 < 最大值,Alice成为"教师"而非"对手"

- 跨语言泛化:Python训练,C/C++漏洞检测提升

- 验证器:程序执行是可程序化验证的外部锚点,可靠且不可伪造

实验结果:

| 任务 | 基线 | SInQ | 提升 |

|---|---|---|---|

| Python Builtin Identifier Swap | 1.65% | 5.35% | +3.70% |

| C/C++ 漏洞检测(跨语言) | 55.23% | 55.60% | +0.37% |

博弈性质:正和博弈——Generator创建有挑战但可解的问题,Evaluator学习解决。

案例4:Afterburner——执行反馈的迭代优化

Afterburner使用执行沙箱(Monolith)作为约束验证器 [ref]:

1 | Afterburner: 生成更高效的代码 |

三种训练策略对比:

| 策略 | 学习本质 | 迭代能力 |

|---|---|---|

| SFT | 表面模式 | 快速饱和 |

| DPO | 静态偏好 | 持续但有限 |

| GRPO | 适应性能力 | 持续改进 |

关键发现:

- GRPO 通过在线RL学习"如何优化"

- Pass@1: 47% → 62%

- 超越人类效率比例: 31% → 45%

动态约束机制:

| 维度 | 实现 |

|---|---|

| 约束来源 | 效率指标的相对提升 |

| 约束进化 | 效率阈值随迭代提升 |

| 稳定机制 | Monolith沙箱提供可靠效率测量 |

四案例对比:验证器质量与博弈性质共同决定上限

| 维度 | PSV | Sol-Ver | SInQ | Afterburner |

|---|---|---|---|---|

| 验证方式 | 形式化验证 | 单元测试 | 程序执行 | 执行沙箱 |

| 验证可靠性 | Sound | Unsound | Sound | Sound(但有边界) |

| 角色 | Proposer + Solver | Solver + Verifier | Generator + Evaluator | 单代理 |

| 训练目标 | 正确性 | 正确性 | 语义推理 | 效率 |

| 动态约束来源 | Proposer生成难度 | 能力协同进化 | 语义理解进化 | 效率阈值提升 |

| 博弈性质 | 难度匹配 | 协同进化 | 正和博弈 | 自我迭代 |

| 能否避免Reward Hacking | 能 | 不能 | 能 | 能 |

关键洞察:验证器的质量决定了动态约束系统的可靠性上限,而博弈性质决定了训练的稳定性。形式化验证和程序执行提供了最可靠的外部锚点,而Positive-sum设计从根本上避免了零和博弈的不稳定性。

批判性反思

框架的局限

-

约束粒度问题

- "不要抄袭"是一个约束还是一个约束族?

- 粒度划分影响验证器设计

- 过细的约束可能失去语义,过粗的约束难以验证

-

验证器的可靠性

- Model-based验证器本身可能不可靠

- 用LLM判断LLM的输出,可能引入新的偏差

- 验证器需要被验证——循环困境

-

约束的动态性

- 用户意图可能在交互中变化

- 预定义的约束可能不适用

- 需要实时调整约束的能力

与批判能力框架的关系

本文的"约束可执行化"框架与"批判能力框架" [ref] 形成互补:

| 框架 | 核心问题 | 关键洞察 |

|---|---|---|

| 批判能力框架 | AI能否批判自己的理论? | 困境来源于外部锚点是否存在 |

| 约束可执行化框架 | 如何实现外部锚点? | 外部锚点=约束验证器 |

批判能力框架定义了问题(可验证预测vs主观判断的区分),约束可执行化框架提供了解决路径(如何为可程序化验证的任务设计外部锚点)。

开放问题

- 约束自动发现:能否从成功/失败案例中自动归纳约束?

- 验证器自动生成:能否自动设计约束验证器?

- 约束冲突解决:当多个约束冲突时,如何权衡?

- 跨任务迁移:约束验证能力能否在不同任务间迁移?

实践指导

对LLM对齐的启示

原则1:显式化约束

- 在设计任务时,显式列出所有约束

- 将隐式约束转化为显式约束

- 约束应该是可操作的

原则2:可执行化验证

- 为每个约束设计验证器

- 优先使用Rule-based验证器

- Model-based验证器需要校准

原则3:分层设计奖励

- 每个约束作为独立的优化目标

- 使用约束验证结果作为奖励信号

- 考虑约束的权重和优先级

原则4:识别风险信号

- 当约束无法自动验证时,是风险信号

- 开放式任务需要额外的监督机制

- 承认不确定性的存在

对Agent开发的启示

设计模式:

1 | 1. 任务分解:将复杂任务分解为可验证的子任务 |

对研究方向的启示

短期方向(1-2年):

- 约束自动识别和验证器自动生成

- Rule-based到Model-based验证器的桥接

- 多约束同时优化的高效算法

中期方向(3-5年):

- 动态约束系统的实现

- 跨任务约束迁移学习

- 内部锚点的理论和实现

长期方向(5年以上):

- 开放式任务的约束涌现机制

- 元约束(约束的约束)的理论框架

- AGI时代的约束可执行化

结论

本文通过整合六个视角的研究发现,揭示了LLM推理能力的结构性基础:外部锚点。推理型LLM的"推理"不是内在能力,而是对外部锚点的结构化响应。外部锚点的实现形式是约束验证器,而约束验证器的实现过程是约束可执行化。

约束可执行化框架为LLM对齐提供了新的设计范式:

- 从"对齐到意图"到"对齐到可执行约束"

- 从"奖励建模"到"约束验证"

- 从"端到端学习"到"结构化验证"

然而,开放式任务的困境仍然存在:并非所有约束都能可执行化。对于无法可执行化的部分,我们需要诚实承认不确定性,并寻求新的机制(如动态约束系统、内部锚点)来突破困境。

未来的研究方向应该是:在最大化约束可执行化的同时,保持对不确定性的诚实,并不断探索突破开放式任务困境的新路径。

参考文献

- Illusions of Reflection: https://arxiv.org/html/2510.18254

- DeepSeek R1: https://arxiv.org/html/2501.12948

- RECAST: https://arxiv.org/html/2505.19030v2

- ACT: https://arxiv.org/html/2403.06326v1

- BRAC (Binding and Retrieval in Action Control): https://pmc.ncbi.nlm.nih.gov/articles/PMC9838247/

- Foerster et al. (2022). Binding Error-Induced Control States: https://pmc.ncbi.nlm.nih.gov/articles/PMC9400645/

- EpiCaR: https://arxiv.org/html/2601.06786v1

- SPIRAL: https://arxiv.org/html/2506.24119

- SInQ (Semantic Inequivalence Game): https://arxiv.org/html/2505.03818

- CRANE (TC^0理论): https://arxiv.org/html/2502.09061v1

- TMBench (计算推理): https://arxiv.org/html/2504.20771v2

- 批判能力框架: ./2026-03-03-040228-note-批判能力与进步机制-约束、能力与度量的统一框架.md

- 校准困境: ./2026-03-04-022036–post-Layer-1预测校准的根本困境-结构性限制与外部机制的必要性.md

完成时间: 2026-03-04 190000

更新时间: 2026-03-05 021500(术语简化:Layer-0/1/2改为描述性术语"可程序化验证/需语义理解/主观判断")