功能性训练的迁移不对称性:为何FC对低层次任务有益却损害推理任务

什么是FC训练?

FC(Functional Correspondence,功能性对应) 是视觉-语言模型中的一种训练任务 [ref]。

核心思想:给定一个物体(如瓶子)和其功能部位(如瓶口),在另一个语义类别不同的物体(如鞋子)上找到对应的功能部位(如鞋口)。

1 | 例子: |

目标:学习"功能性特征"而非"语义特征",期望获得更好的跨类别泛化能力。

悖论发现

两个看似矛盾的研究结论:

| 论文 | 发现 |

|---|---|

| FunKPoint (ICCV 2021) | FC训练提升跨类别少样本泛化 |

| PGF论文 (2025) | FC是Pirate任务,损害其他任务 |

这激发了一个问题:同一训练,为何在不同论文中结论相反?

数据揭示的迁移不对称性

从PGF热力图分析,FC的迁移效果呈现方向性不对称:

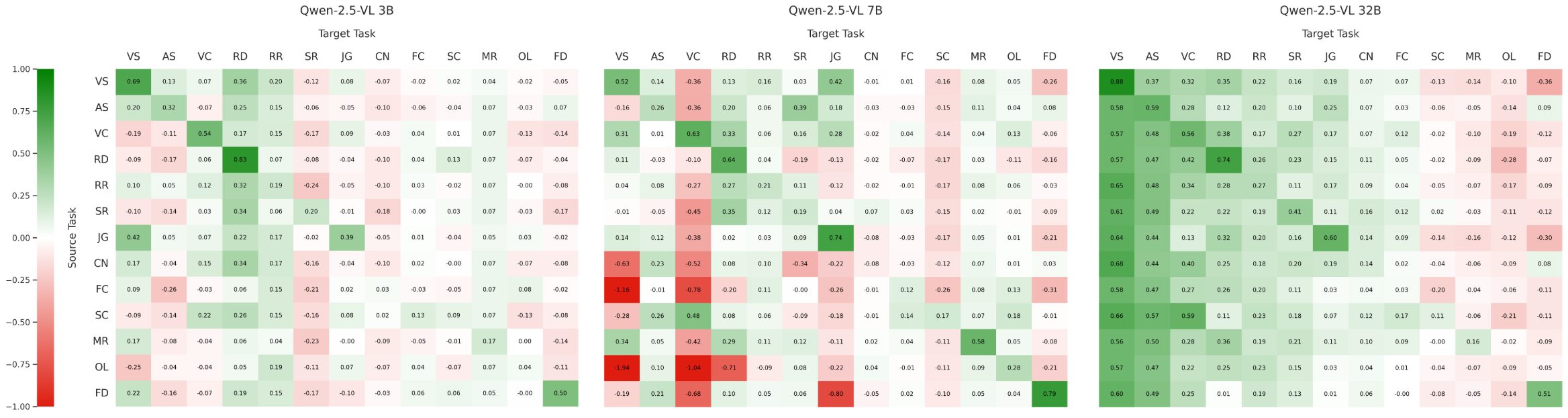

图:Qwen-2.5-VL模型家族(3B, 7B, 32B)的PGF热力图。横轴为目标任务,纵轴为源任务。正值表示正迁移,负值表示负迁移。

| 目标任务类型 | 迁移效果 | 示例 |

|---|---|---|

| 低层次感知 | 轻微正迁移 | Relative Depth, Relative Reflectance |

| 高层次推理 | 负迁移 | Counting, Forensic Detection, Semantic Correspondence |

关键观察:

- FC参与正迁移clique

{FC, JG, OL}(3B模型) - FC参与负迁移clique

{CN, FC, JG}(7B模型) - LoRA权重分析:FC与其他任务的参数更新模式独特

解释:功能性与语义性的竞争

假设:FC训练引入了"功能性表示",这种表示与"语义表示"存在竞争关系。

1 | 低层次任务 ←───┐ |

为什么对低层次任务有益?

- 低层次任务本身可能包含一定的"功能性"成分

- 例如:Relative Depth需要理解物体的"支撑关系"(一种功能)

为什么对高层次推理任务有害?

- 高层次推理任务依赖"语义特征"(类别、属性、关系)

- 功能性特征可能"覆盖"或"干扰"语义特征

与约束可执行化的联系

约束可执行化视角:

| 约束类型 | 可执行性 | 验证器 | 稳定性 |

|---|---|---|---|

| “语义相似” | 高 | 类别标签、外观相似度 | 高 |

| “功能相似” | 低? | 人工标注的功能标签 | ? |

关键问题:FunKPoint的功能标注是否稳定?

不同人对"倒水功能"的理解可能不同:

- “瓶口对应鞋子的哪里?”

- 这可能导致训练信号存在内在噪声

如果标注不稳定,那么:

- FC训练学到的是什么?

- 是"功能性特征"还是"标注者的主观偏好"?

FunKPoint论文的声称vs PGF的发现

FunKPoint声称:因为监督信号不受语义限制,学习到的表示可以在少样本分类上泛化更好。

PGF发现:FC损害其他任务。

调和:

- FunKPoint测试的是跨类别少样本学习(功能性泛化)

- PGF测试的是对其他预训练任务的影响(语义泛化)

两者可能同时成立:

- FC训练提升了功能性任务的泛化

- 但损害了语义任务的泛化

更深的假设:表示空间的结构

如果VLM的表示空间存在正交子空间:

1 | 表示空间 |

那么:

- 语义训练(Semantic Correspondence)优化语义子空间 → 不干扰功能子空间

- 功能训练(Functional Correspondence)优化功能子空间 → 可能干扰语义子空间?

问题:为什么功能训练会干扰语义子空间?

可能的机制:

- 参数竞争:LoRA权重分析显示FC的更新模式独特

- 注意力转移:模型学会"忽略外观,关注功能"

- 表示覆盖:功能性表示"覆盖"了语义性表示

开放问题

-

如何验证"表示竞争"假设?

- 分析FC训练前后,模型在语义任务上的表示变化

- Probe实验:用语义标签probe FC训练后的模型

-

是否可以设计"不损害语义能力"的功能性训练?

- 多任务学习:同时训练Semantic + Functional Correspondence

- 约束保留:在功能性训练时,约束语义能力不下降

-

功能标注的稳定性

- FunKPoint的标注者间一致性如何?

- 这可能是噪声来源

批判性反思

局限性:

- 这是基于两篇论文的间接推断,没有直接实验验证

- "表示竞争"只是假设,可能存在其他解释

与之前批判的呼应:

- 不是"结构不匹配",而是表示类型的竞争

- 这比"结构匹配"更具体,但仍需验证

关键引用:

关联探索:

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Aletheia!

评论