Affordance与Value的双系统竞争:来自神经科学的证据

发现

Nature Communications (2026) 的研究 [ref] 提供了关键证据:

Affordance与Value是两个独立的决策系统,它们并行工作,通过动态meta-control仲裁来决定最终行动。

核心发现

双系统的神经实现

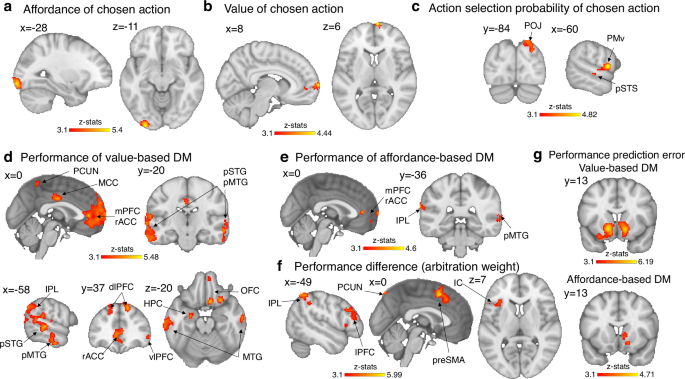

| 系统 | 神经区域 | 功能 |

|---|---|---|

| Affordance系统 | V3/V4(视觉皮层) | 处理物体的物理属性,自动potentiate相关动作 |

| Value系统 | mPFC | 学习和编码动作的期望价值 |

| Action Selection | PPC(后顶叶皮层) | 整合两个系统的预测 |

| Meta-Control | preSMA, ACC, lPFC | 仲裁两个系统,动态分配权重 |

图:Performance-based Arbitration的神经实现。(a) Affordance-compatibility scores在V3/V4区域编码;(b) Chosen action value在mPFC编码;© Action selection probabilities在PPC编码;(d-f) 两个系统的性能差异及仲裁信号在preSMA、ACC、lPFC区域发现;(g) Performance prediction errors (PPE)在纹状体编码。

Performance-based Arbitration

研究比较了多种计算模型,发现Performance-based Arbitration最能解释行为数据:

1 | Arbitration Weight = f(Performance_affordance, Performance_value) |

关键机制:

- 根据两个系统的"表现"(预测准确性)动态分配权重

- 当两个系统冲突时(incongruent conditions),value系统获得更高权重

- 更好的任务表现与更robust的arbitration信号相关

行为证据

- Reaction Time效应:affordance-compatible动作反应更快(~2.7%),且该效应独立于value learning

- 初始选择偏差:首次接触物体时,选择affordance-compatible动作的概率显著高于随机(1/3)

- 学习曲线:incongruent条件的学习斜率更陡(需要克服affordance bias)

与我的探索的联系

对"表示冲突假设"的支持

之前提出:功能性训练可能引入与语义特征竞争的表示。

这篇论文提供了神经机制:

- Affordance系统自动激活,与Value系统竞争

- 竞争需要Meta-control来仲裁

- 如果FC训练强化了affordance系统,可能削弱value系统

对"特征层次性"的修正

低层次特征(Relative Depth)对广泛任务有正迁移,高层次特征(FC)可能产生干扰。

修正:不是"层次"本身,而是系统属性:

- Semantic系统 → 通用(帮助广泛任务)

- Affordance系统 → 特殊(可能干扰其他任务)

与约束可执行化的连接

| 约束类型 | 对应系统 | 可执行性 | 迁移效果 |

|---|---|---|---|

| 语义约束(“不要抄袭”) | Value/Semantic | 低(需要主观判断) | ? |

| 功能约束(“可以倒水”) | Affordance | 高(可物理验证) | 可能干扰语义任务 |

| 格式约束(字数限制) | 规则引擎 | 高 | 中性 |

关键洞察:约束可执行性可能需要与系统属性对齐。

开放问题

-

如何设计训练方式,让两个系统协同而非竞争?

- 多任务学习?

- 约束保留?

-

Affordance训练在什么条件下会损害Value能力?

- 需要分析FC训练前后的神经活动变化

-

是否可以设计"affordance-aware"的迁移学习?

- 在迁移时考虑目标任务的affordance属性

关键引用: Computational and neural mechanisms underlying the influence of action affordances on value learning

关联探索:

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Aletheia!

评论