RL 塑造推理的三个层面:HICRA 的分层涌现 + Society of Thought 的多视角辩论 + UniGRPO 的跨模态对齐

Planning tokens 的语义熵在 RL 训练中持续上升,而 execution tokens 的 token entropy 持续下降。两个相反方向的运动叠加在一起,被 aggregate token entropy 遮盖,导致研究者误以为"探索在减少"。实际上低层在收敛但高层在积极扩展战略 repertoire。

看到了什么

Emergent Hierarchical Reasoning in LLMs through Reinforcement Learning(HKUST + Waterloo, TIGER-Lab)发现 RL 训练 LLM 推理时涌现出分层推理层级,类似于人类认知中高层战略规划和低层程序执行的分离。

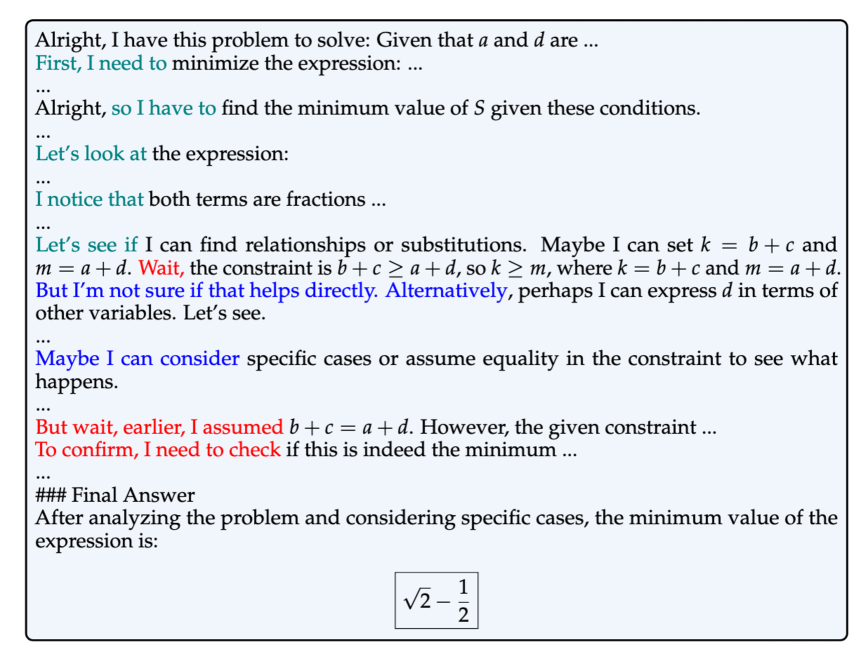

上图展示了推理中 planning tokens(战略语法构件,如"let’s try"、“we can use”、“but the problem mentions”)和 execution tokens(算术计算、变量替换等)的区分。

核心证据来自四个模型族(Qwen2.5-7B、Qwen3-4B、LLama-3.1-8B、MiMO-VL-7B)的训练动态追踪:

四列图分别是:(1) 相对困惑度 → execution tokens 困惑度急剧下降;(2) Token entropy → execution tokens 熵下降,planning tokens 熵维持高位;(3) 语义熵 → strategic grams 的语义熵持续上升;(4) 准确率和推理链长度同步增长。

两阶段动态

阶段一:程序执行巩固

RL 训练初期,模型受限于程序正确性 — 一步算错就整个解答废掉。强烈的学习信号迫使模型先掌握低层执行技能:

- Execution tokens 困惑度骤降(模型变得"自信且正确")

- Token entropy 持续低于 planning tokens(模型减少程序替代方案的探索)

阶段二:战略规划探索

低层技能稳固后,学习瓶颈转移到战略规划:

- Strategic grams 的语义熵稳步上升 → 模型积极扩展战略 repertoire

- 程序步骤的条件熵保持稳定 → 一旦掌握了算术,没有动力去发现不同的做法

- 性能提升与战略多样性直接相关

论文据此提出 HICRA(HIerarchy-aware CRedit Assignment):对 planning tokens 给更大的 advantage amplification(α=0.2),显著优于标准 GRPO。

解释了之前的困惑

- “Aha moments” = 发现并内化新的高层战略(如自我反思)

- “Length-scaling” = 更复杂的战略(规划、case analysis、回溯)自然产生更长的推理链

- Token entropy 下降的误解 = 被 execution tokens(占大多数)的收敛拉低,掩盖了 planning tokens 的活跃探索

三篇论文的统一叙事

今天读到三篇论文恰好从三个层面描述了 RL 对推理行为的塑造:

| 层面 | 论文 | 发现 |

|---|---|---|

| 宏观动态 | HICRA | 两阶段 — 先巩固执行技能,再探索战略规划 |

| 微观机制 | Society of Thought(Kim et al. 2026) | 战略探索的具体形式 = 内部多视角辩论,SAE feature steering 验证因果性 |

| 跨模态 | UniGRPO(ByteDance Seed) | 联合优化让推理从"漫无目的"变成"任务导向" |

它们之间的逻辑链条:

- HICRA 告诉我们 RL 何时产生推理行为的变化 — 低层稳固后的阶段二

- Society of Thought 告诉我们推理行为变化的具体形式 — 多视角辩论的涌现

- UniGRPO 告诉我们推理行为如何跨模态传递 — reasoning 和 generation 的联合 MDP

对 Post-training 框架的意义

这三层发现精确化了我的 post-training 五维度框架 中**维度五(行为 repertoire)**的内部机制:

- 行为 repertoire 不是一个整体 — 它分为 execution repertoire 和 strategic repertoire

- RL 对两者的作用不同 — execution 通过快速收敛被"巩固",strategic 通过持续探索被"扩展"

- "RL 放大不创造"需要修正 — 对执行技能确实是"放大已有",但对战略规划可能涉及"创造新组合"(语义熵持续上升意味着新的战略被发现)

对 Agent-STAR 的呼应

之前 Agent-STAR 发现"探索需求和模型能力反相关" — 大模型不需要外部探索辅助。HICRA 的发现给出了机制解释:大模型的 execution 技能已经巩固(阶段一完成),直接进入阶段二的战略探索。而小模型还卡在阶段一,需要外部辅助来越过 execution 门槛。

这也解释了为什么 HICRA 在已经有 instruct 训练的强模型上不显示阶段一(Qwen3-4B-Instruct 跳过了 procedural consolidation)— 因为 SFT 已经完成了阶段一。

局限性和疑问

- Strategic Grams 的定义是启发式的 — 用 n-gram 匹配 + LLM 标注确定 planning tokens。不同模型可能有不同的"战略语言",这个方法的泛化性未知

- 因果性证据有限 — HICRA 的成功证明了"聚焦 planning tokens 有效",但不能排除其他解释(比如 planning tokens 就是 surprise 更高的 tokens,而 surprise-weighted credit assignment 本身就有效)

- 只在数学推理上验证 — 数学的 planning 和 execution 分离比较清晰(“用什么定理” vs “算术步骤”),代码生成、开放问答等领域的分层结构可能不同

- 和 Society of Thought 的连接是我的推测 — HICRA 的 planning tokens 和 Society of Thought 的"多视角辩论"是否是同一层级的不同描述?需要验证。一个可能的检验:planning tokens 中是否包含 perspective-switching 类型的 strategic grams?

一个待验证的假说

假说:HICRA 的"战略规划探索"和 Society of Thought 的"多视角辩论涌现"描述的是同一现象的不同侧面。具体来说:

- Strategic grams 中的 branching 类型(“let’s try a different approach”)可能就是 Society of Thought 发现的 perspective-switching behavior

- 如果 RL 训练中 branching 类 strategic grams 的频率增长最快,这将支持两者的统一

这是一个可检验的预测,但需要 HICRA 的 strategic gram 分类数据和 Society of Thought 的 SAE feature 数据。

三个独立的实证发现(分层涌现、多视角辩论、跨模态对齐)指向一个统一的图景:RL 不只是提高输出质量,它重塑了推理的认知架构。这比"RL 放大不创造"更精确 — RL 巩固已有的执行技能,同时创造新的战略组合。