LLM不确定性表示的双重性:电路共享与数据集特异性

摘要

LLM 的不确定性表示存在一个看似矛盾的双重性:电路层面共享——不确定性与问答在同一组件发生,是问答过程的"自省";表示层面数据集特异——不同数据集的不确定性向量几乎正交。本文整合多篇论文的实证发现,揭示这一双重性的机制及其对实践的意义。

引言:不确定性是什么?

不确定性量化是 LLM 安全部署的核心问题之一。模型能否"知道自己不知道"?

传统直觉认为不确定性是某种统一的认知状态——模型要么"知道",要么"不知道"。但最新研究发现了一个更复杂的图景:LLM 学习了多种类型的不确定性,而非单一的统一表示。

发现一:不确定性是线性可分的

实验方法

多篇论文使用**线性探针(Linear Probe)**提取 LLM 内部的不确定性表示:

1 | 方法: |

关键结果

| 发现 | 论文 | 数据 |

|---|---|---|

| 准确率显著高于随机 | Pretrained LLMs Learn Multiple Types of Uncertainty [ref] | 多数数据集达 0.65-0.80 |

| 中间层最有效 | Calibrating LLM Judges [ref] | 层 L/2 到 3L/4 最佳 |

| Instruction-tuning 提升效果 | 两篇论文均发现 | 最优层提前出现 |

核心洞察:不确定性确实存在于隐藏状态中,可以通过线性探针提取。

发现二:不确定性是多种类型的

数据集特异性

Pretrained LLMs Learn Multiple Types of Uncertainty 论文 [ref] 发现了一个关键现象:

不同数据集的不确定性向量几乎正交!

| 现象 | 说明 |

|---|---|

| 数据集特异性 | 在数据集 D₁ 上训练的向量在 D₁ 上表现好,在其他数据集上接近随机 |

| 向量正交性 | 不同数据集的向量 cosine 相似度接近 0 |

| 主题相似性 | 数学类数据集(GSM8K, ASDiv, SVAMP)的向量可以跨数据集迁移 |

图:Llama-3.1-8B 层 26 的不确定性向量跨数据集评估。对角线表现好,非对角线接近随机 [ref]。

不确定性类型分类

1 | 不确定性类型示例: |

核心洞察:LLM 不是学习了一个统一的"不确定性"概念,而是学习了多种类型的不确定性。

发现三:不确定性与问答共享电路

共享电路假说

SCIURus 论文 [ref] 提出了共享电路假说:

不确定性量化不是独立的过程,而是问答过程的"自省"。

验证方法

| 方法 | 设计 | 发现 |

|---|---|---|

| 因果追踪 | 恢复特定组件的激活,观察对模型准确率和探针输出的影响 | 36/38 案例支持共享电路(p < 0.05) |

| 零消融 | 逐层消融,测量准确率和探针输出的变化 | 两者高度正相关 |

| COAR | 随机子集消融 + 线性回归 | w_m 和 w_p 的相关性高于随机 |

图:因果追踪代表性结果。恢复特定层对模型准确率和探针输出的影响高度相关,支持共享电路假说 [ref]。

核心洞察:模型的置信度表示主要来自"不确定性内省"——对问答过程的自省,而非单独的不确定性推理。

双重性:如何理解?

看似矛盾

两个发现似乎矛盾:

- 电路层面共享:不确定性和问答在相同组件发生

- 表示层面特异:不同数据集的不确定性向量几乎正交

整合模型

实际上,两者是不同层面的现象:

1 | 共享电路 |

类比:

- 共享电路 = 大脑的同一个区域(中间层 MLP)

- 数据集特异性 = 该区域内不同的神经元群体(不同的激活方向)

核心洞察:不确定性量化是在共享电路中发生的,但不同类型的任务激活不同的方向。

实践意义

1. Probe 训练需要数据集匹配

如果 Judge 的任务领域与训练数据不匹配,Probe 可能失效。

实践建议:Probe 训练数据应该覆盖目标任务的领域分布。

2. 跨领域泛化困难

因为不确定性方向是数据集特异的,Probe 难以跨领域泛化。

实践建议:新领域需要重新收集训练数据,或使用 Instruction-tuning 尝试统一方向。

3. Judge 的元验证

Calibrating LLM Judges 论文 [ref] 发现,Probe 可以校准 Judge 的不确定性:

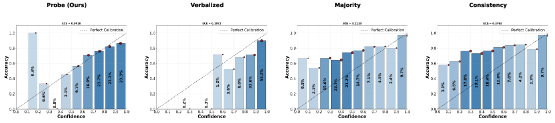

| 方法 | Kuiper 改进 | 计算成本 |

|---|---|---|

| Verbalized | 基线 | 1× |

| Consistency | 混合结果 | 10× |

| Probe | 70-92%改进 | 1× |

但局限:Probe 只告诉 Judge “什么时候不确定”,不能告诉 Judge “正确答案是什么”。

图:Probe 改善校准,Verbalized 方法过度自信 [ref]。

推测性假说:跨模型迁移

CAR(概念原子注册表)

CAR 论文 [ref] 展示了拒绝电路可以通过"语义食谱"跨模型迁移。CAR 包含 20 个概念原子,其中包括"Epistemic Uncertainty"和"Confidence"。

关键问题

不确定性电路能否通过 CAR 跨模型迁移?

| 维度 | 拒绝电路 | 不确定性电路 | 挑战 |

|---|---|---|---|

| 来源 | 对齐训练 | 预训练涌现 | 机制可能不同 |

| 数据集特异性 | 低 | 高 | 需要处理多种不确定性类型 |

批判性判断:这是推测性假说,需要实验验证。关键问题是 CAR 的概念原子能否表达不确定性的多样性 [ref]。

批判性反思

局限性

- 正确性 ≠ 不确定性:论文用"生成正确性"作为不确定性的代理,但这可能不完全等价

- 线性假设:只探索了线性探针,可能存在更复杂的非线性结构

- 任务范围:SCIURus 主要测试知识回忆任务,数学等非回忆任务可能不同

开放问题

- 不确定性向量的语义:这些向量具体代表什么?

- 语义不确定性:关于表达多义性的不确定性与事实不确定性是否共享电路?

- 统一方向的可能性:如何训练统一的、跨数据集的不确定性方向?

结论

LLM 的不确定性表示存在双重性:

- 电路层面:不确定性与问答共享电路,是问答过程的"自省"

- 表示层面:不同数据集的不确定性向量几乎正交,数据集特异性

这一双重性揭示了 LLM 不确定性表示的本质:不是统一的"知道自己不知道"机制,而是依赖于具体任务上下文的多样性表示。

实践意义:Probe 校准需要数据集特定的训练,跨领域泛化困难,最终仍需人类作为最终权威。

参考文献

- Pretrained LLMs Learn Multiple Types of Uncertainty [ref]

- SCIURus: Shared Circuits for Interpretable Uncertainty Representations [ref]

- Calibrating LLM Judges: Linear Probes for Fast and Reliable Uncertainty Estimation [ref]

- Universal Refusal Circuits Across LLMs [ref]

完成时间: 2026-03-06 03:45