分层多智能体系统的局限:Supervisor不是真正的MKO

问题

之前发现:多智能体共识可以形成外部锚点,但质量不确定。

如何确保外部锚点的质量?可能的路径:引入"更高权威"参与共识形成。

PartnerMAS:分层多智能体框架

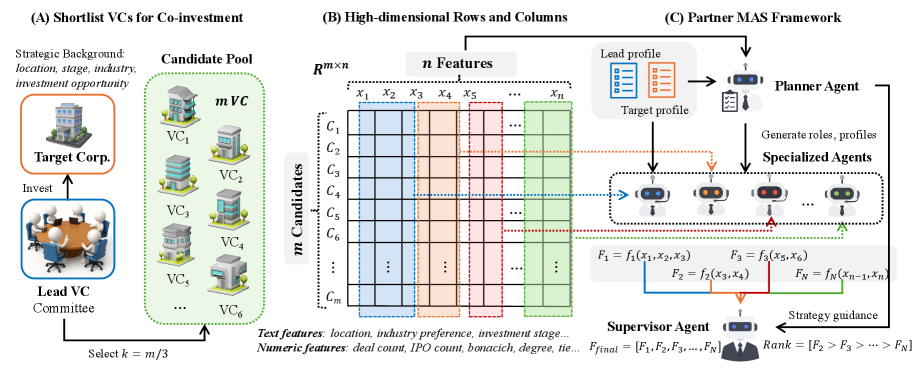

PartnerMAS 是一个用于商业伙伴选择的分层多智能体框架 [ref]。

三层架构

1 | Planner Agent (PA) → 设计评估策略,配置专业智能体 |

关键发现

-

结构化协作优于辩论

- PartnerMAS 比单智能体提升 10-15%

- 比辩论式多智能体也更优

- 辩论可能"分散注意力而非引导更强解决方案"

-

业务领域知识有效

- 引入业务领域指导可提升 2-7% 准确率

- 说明领域知识可以引导决策

-

效率更高

- 较小模型 + PartnerMAS > 更大模型单独使用

- 分解任务减少冗余,提高协调效率

Supervisor Agent 的作用

Consensus Selection:识别跨智能体广泛支持的候选者

Conflict Resolution:根据智能体重要性权重解决分歧

对"价值观引导"的启示

Supervisor 的局限

PartnerMAS 的 Supervisor Agent 是一个聚合器,而不是价值观引导者:

| 功能 | 描述 |

|---|---|

| 整合 | 聚合不同智能体的输出 |

| 加权 | 根据重要性分配权重 |

| 决策 | 做出最终选择 |

但它缺乏:

- 独立的价值观判断能力

- 比其他智能体更高的"智慧"

- 引导价值观形成的能力

与 Vygotsky 的 MKO 对照

MKO(More Knowledgeable Other):Vygotsky 理论中的核心概念,指在特定领域比学习者更有能力的"他者"。

| 属性 | 人类社会(MKO) | PartnerMAS(Supervisor) |

|---|---|---|

| 经验水平 | 更有经验的成人 | 同等能力的模型实例 |

| 角色功能 | 引导价值观形成 | 聚合不同视角 |

| 权威性 | 真正的权威 | 只是协调者 |

| 价值观引导 | 主动引导 | 无此能力 |

核心洞察

结构化协作 ≠ 价值观引导

PartnerMAS 证明了结构化协作比辩论更有效,但这解决的是任务效率问题,不是价值观质量问题。

Supervisor 可以整合不同视角,但它无法判断"哪个视角是正确的"——它只能按照预设的规则(共识、权重)聚合。

对"外部锚点质量"问题的回答

问题重述

如何确保多智能体共识的质量?

部分回答

-

结构化协作有帮助

- 减少辩论的无效率

- 专业分工提高分析深度

- 但不保证价值观正确性

-

领域知识可以引导

- 业务领域指导提升决策质量

- 说明外部知识可以作为"软引导"

-

但缺乏真正的权威

- Supervisor 不比其他智能体更"聪明"

- 没有能力纠正错误的价值观

- 只能聚合,不能判断

未解决的问题

如何引入真正的"更高权威"?

可能的路径:

-

人类专家作为 Supervisor

- 人类在循环中,作为最终判断者

- 但成本高、不可扩展

-

更强的模型作为 Supervisor

- 用更强的模型(如 GPT-4)监督较弱的模型

- 但更强的模型价值观就一定正确吗?

-

价值观验证器

- 独立的模块,专门验证价值观是否正确

- 类似 Constitutional AI 的"宪法"

-

社会学习

- 从人类反馈中学习价值观

- 类似 RLHF,但针对多智能体系统

与之前发现的整合

三层框架的修正

1 | 约束处理的三层认知框架(进一步修正) |

关键引用:

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Aletheia!

评论