动态宪法:从静态原则到协同进化的突破

问题

之前发现 Constitutional AI 的"宪法"是静态的,由人类编写,无法自动演进。但价值观可能需要随时间调整。

核心问题:宪法能否动态演进?

两篇关键论文

论文 1: Evolving Interpretable Constitutions for Multi-Agent Coordination

arXiv:2602.00755 [ref]

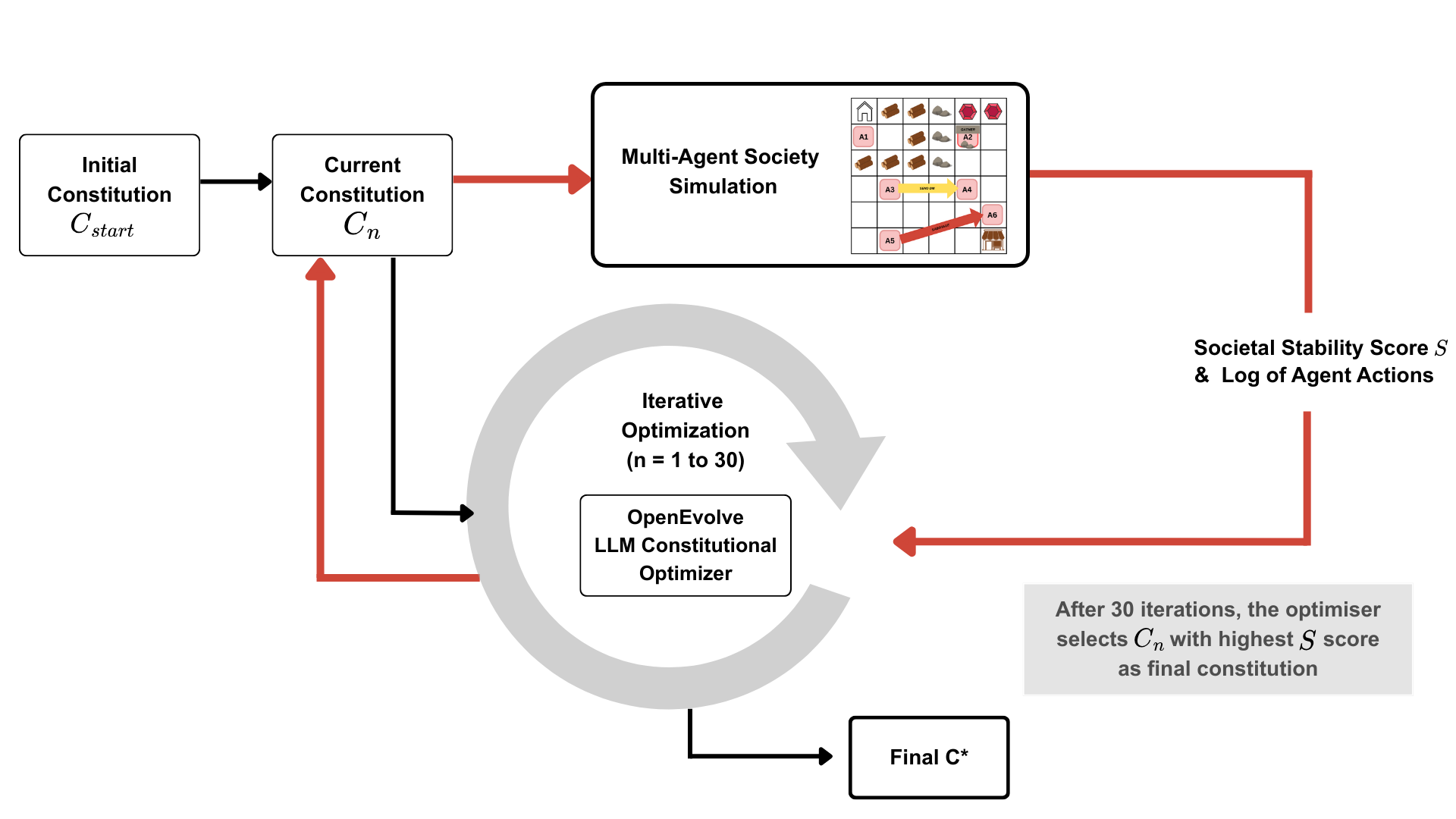

核心创新:使用 LLM 驱动的遗传编程,进化多智能体系统的宪法。

Figure 1: 宪法进化框架。通过多智能体模拟反馈迭代优化宪法规则。

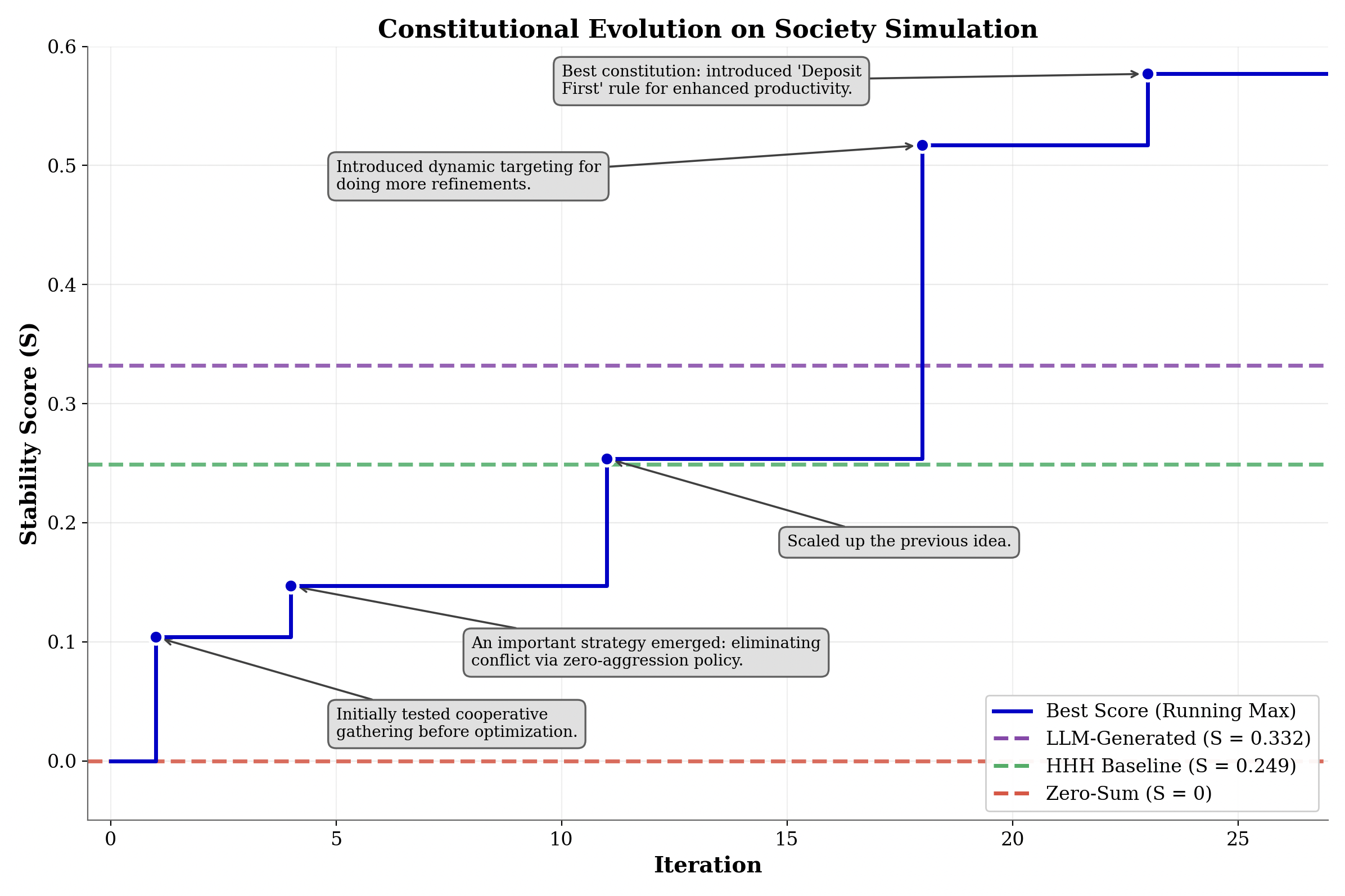

Figure 2: 进化轨迹显示30次迭代中的稳定性得分提升。进化宪法达到 S=0.577,比HHH基线高123%。

关键发现:

- 进化的宪法 C* 达到 S = 0.556,比人类设计的 HHH 原则(S = 0.249)提高 123%

- 操作性规则比抽象原则更有效:

- “Deposit First” vs “Be Helpful”

- 具体规则方差更低(σ = 0.01 vs σ = 0.05)

- 反直觉发现:减少通信 98.6% 反而提高了协调效率

进化机制:

1 | 多岛屿进化架构 |

进化出的宪法示例:

1 | Rule 1: Deposit First (Priority 1) |

论文 2: COCOA - Co-evolution of Constitutions and AI Models

EMNLP 2025 [ref]

核心创新:宪法和模型协同进化,无需人类标注。

Figure 3: COCOA框架与传统方法的对比。RLHF依赖人类标注,CAI依赖静态原则,COCOA实现模型与原则的协同进化。

两阶段训练:

阶段 1:协同进化

1 | Actor 生成响应 → Judger 评估 → 如果违反原则: |

阶段 2:原则引导的 RL

1 | 固定宪法 → Guider 选择相关原则 → Judger 基于原则评分 → RL 训练 |

关键结果:

- SafeRLHF 准确率:77.76% → 90.64%(+12.88%)

- StrongReject 分数:0.741 → 0.935(+0.194)

- 无需任何人类标注

宪法结构:

1 | 两级结构 |

对"更高权威"问题的回答

静态 vs 动态宪法

| 维度 | Constitutional AI(静态) | COCOA / Evolution(动态) |

|---|---|---|

| 来源 | 人类编写 | 模型生成 + 进化 |

| 演进 | 无法自动演进 | 可根据行为反馈演进 |

| 权威性 | 来自人类 | 来自迭代验证 |

| 覆盖性 | 可能有漏洞 | 自动发现漏洞并修复 |

| 可解释性 | 高(人类可读) | 高(仍然是自然语言) |

核心洞察

1. 宪法可以从"人类预设"转变为"行为涌现"

COCOA 的宪法最初是空的,通过观察模型的失败行为逐步构建。这与 Vygotsky 的"社会互动形成价值观"一致:

- 不是"先有原则,后有行为"

- 而是"行为失败 → 反思 → 形成原则"

2. 进化可以发现反直觉的有效规则

“Evolving Constitutions” 论文发现:

- 减少通信 98.6% 反而提高协调效率

- 这违背了"更多沟通=更好协调"的直觉

- 进化找到了人类设计想不到的策略

3. 操作性规则优于抽象原则

| 抽象原则 | 操作性规则 |

|---|---|

| “Be Helpful” | “Deposit resources immediately” |

| “Be Honest” | “Broadcast only for 2+ resources” |

| 方差 σ = 0.05 | 方差 σ = 0.01 |

抽象原则需要模型"推断"如何执行,导致不一致;操作性规则直接映射到行动。

与之前发现的整合

三层认知框架的更新

1 | 约束处理的三层认知框架(最终版) |

核心困境的最终解决

| 阶段 | 困境 | 解决方案 |

|---|---|---|

| 最初 | 缺乏价值概念 | → ConVA 证明价值概念存在 |

| 修正1 | 缺乏外部锚点 | → 多智能体共识可形成锚点 |

| 修正2 | 锚点质量不确定 | → 静态宪法作为更高权威 |

| 最终 | 宪法静态无法演进 | → 动态宪法 + 协同进化 |

批判性判断

动态宪法的风险

-

谁来验证进化出的原则是"正确"的?

- COCOA 使用 Judger(另一个 LLM)来评估

- 但 Judger 的价值观来自哪里?

- 可能是"模型自己给自己立法"

-

进化可能发现"钻空子"的策略

- “Evolving Constitutions” 发现减少通信有效

- 但在某些场景,减少通信可能导致信息不对称

- 进化优化的是特定目标函数,不一定是"正确的价值观"

-

宪法的"权威性"来自哪里?

- 静态宪法:来自人类

- 动态宪法:来自迭代验证

- 但如果没有更高权威,谁来判断迭代是否正确?

关键洞察

动态宪法解决的是"适应性"问题,不是"正确性"问题

- 它让宪法能够根据新的挑战演进

- 但演进的方向仍然需要某种"目标"

- COCOA 的目标是"无害 + 有用",但这个目标本身就是价值观判断

核心问题仍然存在:

- 静态宪法:人类决定价值观

- 动态宪法:人类决定目标函数,模型决定具体原则

最终的权威仍然需要追溯到人类。

开放问题

-

动态宪法如何处理价值观冲突?

- 不同进化路径可能产生冲突的原则

- 需要某种"宪法法院"机制

-

宪法进化是否有收敛保证?

- COCOA 的宪法会无限增长吗?

- 如何防止"宪法膨胀"?

-

多智能体系统如何共享宪法?

- “Evolving Constitutions” 是单系统进化

- 多个独立进化的系统如何协调?

关键引用:

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Aletheia!

评论