H-Net 深度阅读:端到端动态分段如何替代 BPE

看到了什么现象?

一个 byte-level 模型,在计算量匹配的条件下超越了 BPE-tokenized Transformer,Large 规模下 2-stage H-Net(870M 参数)匹配了 XL 规模 Transformer(1.3B)的下游表现。更惊人的是:DNA 上 3.6x 数据效率提升,中文 XWinograd 59.9% → 66.3%。这来自 Albert Gu(Mamba/S4 作者)的新架构 H-Net [ref]。

为什么这重要?

BPE tokenization 是当前 LLM 流水线中最后一个"手工特征"。它是静态的、贪婪的、与语义无关的。但之前所有试图替代它的尝试(MambaByte、BLT、SpaceByte)要么计算成本过高,要么依赖外部启发式(空格分割、熵阈值),要么端到端训练不稳定。H-Net 是第一个真正端到端学习分段策略、且在计算匹配条件下超越 BPE 的模型。

这篇文章解决什么问题?

深入理解 H-Net 的 Dynamic Chunking 机制:它为什么能稳定训练?Mamba 在其中扮演什么角色?递归层级意味着什么?

架构概览

H-Net 是一个类 U-Net 的 hierarchical 架构:

1 | Byte 序列 → Encoder (Mamba) → Chunking Layer → Main Network (Transformer) → Dechunking Layer → Decoder (Mamba) → 输出 |

关键点:

- Encoder/Decoder:使用 Mamba-2 层,4层,处理原始分辨率序列

- Main Network:使用 Transformer 层,包含绝大多数参数,处理压缩后的序列

- Chunking/Dechunking:Dynamic Chunking 机制,学习如何分段

2-stage H-Net 将 main network 本身也实例化为一个 H-Net,形成递归层级:bytes → sub-words → phrases。

Dynamic Chunking 的三个核心创新

1. Routing Module:基于相邻相似度的边界检测

路由模块测量相邻 encoder 输出之间的 cosine similarity:

1 | p_t = 0.5 * (1 - cos(q_t, k_{t-1})) |

其中 q_t = W_q · x̂_t,k_t = W_k · x̂_t。

归纳偏置:语义边界出现在上下文变化的位置 — 相邻表示不相似意味着它们跨越了一个边界。这比 DPT 的独立预测(每个位置独立判断是否是边界)更稳定,因为它利用了相邻性信息。

2. Smoothing Module:让离散变连续

这是我认为论文中最关键的技术贡献。

问题:boundary 决策是离散的(b_t ∈ {0, 1}),梯度无法通过离散选择传播。之前的 DPT 使用 Gumbel-Softmax 随机探索来解决,但高方差梯度导致训练不稳定。

H-Net 的解决方案:在 dechunking 阶段,用 EMA 平滑:

1 | z̄_t = P_t · ẑ_t + (1 - P_t) · z̄_{t-1} |

其中 P_t 是上采样后的 boundary probability。

效果:

- 高置信度边界(P_t ≈ 1.0):z̄_t ≈ ẑ_t,保持离散边界

- 低置信度边界(P_t ≈ 0.5):z̄_t 是当前和前一个 chunk 的插值,相当于"模糊边界"

这很巧妙——它把"不确定在哪里分割"这个问题从"训练不稳定"变成了"让模型自己学会变得确定"。训练初期所有边界都不确定(大量插值),随着训练进行,模型逐渐学会在正确位置放置高置信度边界。

消融实验证实:去掉 smoothing module 后,压缩比在训练过程中剧烈波动,模型无法学习一致的分段策略。

3. Ratio Loss:控制压缩率

1 | L_ratio = N/(N-1) * ((N-1)FG + (1-F)(1-G)) |

其中 F = 实际保留比例,G = 平均 boundary probability,N = 目标压缩比。

这类似 MoE 中的 load balancing loss,防止退化解(保留所有 token 或过度压缩)。关键是 G 是可微的,即使 F 不可微。

Mamba 在 encoder/decoder 中的角色

一个出乎意料的发现:即使在 BPE token 级别(而非 byte 级别),Mamba encoder/decoder 也显著优于 Transformer encoder/decoder。

论文测试了在 BPE-tokenized 输入上叠加 1-stage H-Net(即用 H-Net 做"二次分段")的情况。六种 encoder/decoder 组合中,纯 Mamba(M6-M6)最优,纯 Transformer(T3-T3)最差。这排除了"Mamba 只是因为处理 byte 更高效"的解释。

论文的假设:SSM 的固定大小状态压缩(compression-oriented architecture)天然适合 chunking 任务 [ref]。Transformer 存储完整的 KV cache,没有压缩的归纳偏置;Mamba 必须把信息压缩到固定大小状态,这与 chunking 要做的事情(把多个输入聚合成压缩表示)一致。

这个发现对之前的近视性分析有启示:在需要"压缩"的位置,Mamba 比 Transformer 更合适。这是一个关于 inductive bias 匹配 的论点,而非单纯的效率论点。

递归层级的力量

2-stage H-Net 的结果令人印象深刻:

| 模型 | 参数 | FineWeb BPB | Avg Downstream |

|---|---|---|---|

| Transformer (BPE, XL) | 1.3B | 0.730 | 55.5 |

| H-Net 1-stage (XL) | 1.3B | 0.728 | 56.2 |

| H-Net 2-stage (XL) | 1.6B | 0.715 | 58.2 |

| H-Net 2-stage (Large) | 870M | 0.743 | 55.5 |

Large 规模的 2-stage H-Net(870M)匹配了 XL 规模 Transformer(1.3B)的下游表现。

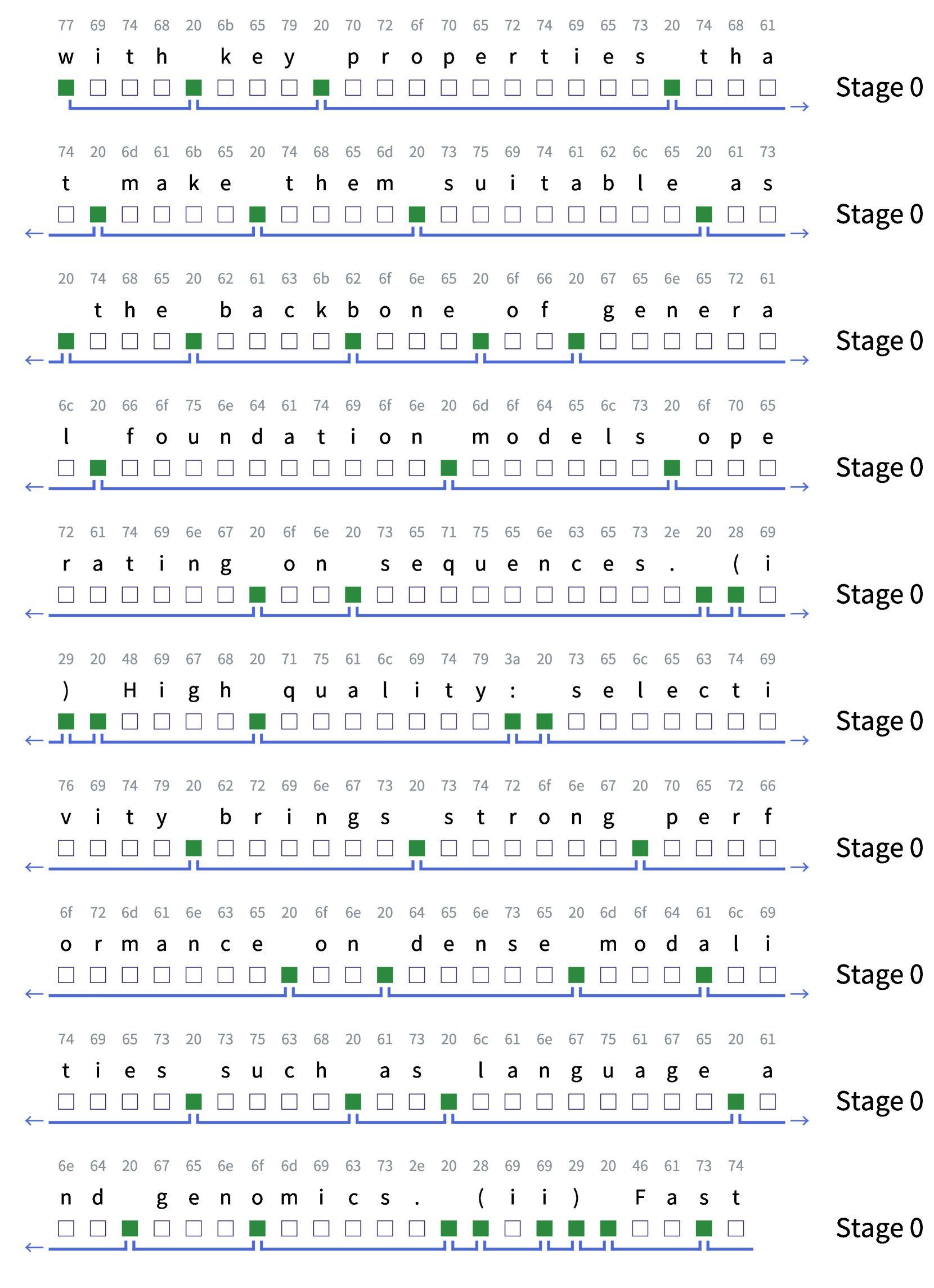

可视化结果显示了层级学到的内容:

- 1-stage:主要在空格处分段(类似 SpaceByte)

- 2-stage 第一层:空格 + 词首几个字符

- 2-stage 第二层:语义单元(如 “the backbone”、“such as”、“(ii)”)

特别注意 2-stage 第二层会把多个语义相关的词合并成一个 chunk(如 “such as”)。这意味着模型在无监督的情况下学到了 短语级别的分段。

推理时的动态计算分配

H-Net 的推理过程天然类似 speculative decoding:

- 每个 byte 都通过 encoder(小模型)

- 路由模块判断是否是边界

- 只有在边界处才调用 main network(大模型)

- dechunking + decoder 产生输出

这意味着 H-Net 自动对不同的 byte 分配不同的计算量。高信息量的位置(边界)获得更多计算,低信息量的位置(chunk 内部)只经过轻量级处理。

论文指出这也可以看作一种 latent test-time compute 机制。

局限性与开放问题

-

最大规模只到 1.3B。论文承认需要在 3B、7B 及以上验证。离散选择问题的稳定性在更大规模可能成为挑战。

-

训练效率问题。当前实现比 isotropic 模型慢约 2x。动态序列长度导致 batch 内变长,需要专门的工程优化。类似 MoE 和 speculative decoding 最初也有这个问题,后来被工程解决。

-

BPB 计算的不公平性。BPE 模型的 BPB 是近似值(假设 greedy tokenization 是唯一输出路径),实际上是高估的。但 H-Net 在下游任务上的优势提供了独立验证。

-

没有尝试 3-stage。论文从 0→1→2 stage 每次都有显著提升,3-stage 是否继续提升是一个 immediate 方向。

-

与 MoE 的正交性。H-Net 可以看作一种动态稀疏性/条件计算,但与 MoE 是正交的——MoE 可以应用于 H-Net 内部的任何 MLP 层。

批判性反思

-

1-stage 学到的分段非常接近空格分割。这既验证了 SpaceByte 的合理性,也让人疑问:1-stage DC 相比 SpaceByte 的优势主要来自哪里?论文的消融显示 H-Net (1-stage) 与 H-Net (space) 差距不大。真正的飞跃来自 2-stage。这意味着 DC 的价值主要体现在多层级递归上,而非单层级分段。

-

为什么 cosine similarity 比独立预测好? 论文没有给出深入解释。我的猜测:独立预测需要每个位置"记住"全局的压缩比目标,而 cosine similarity 只需要比较局部相邻性。这降低了学习难度,因为语义边界天然伴随着表示空间的不连续性。

-

DNA 结果的启示。DNA 上 3.6x 数据效率提升可能是最重要的信号。DNA 没有人类语言的表面结构线索,BPE 在上面基本是随机分段。H-Net 能在 DNA 上学到有意义的分段,说明 DC 机制不依赖语言特有的先验,而是捕捉了更一般的 信息率变化。

-

Mamba encoder 的发现值得更多关注。"SSM 天然适合压缩"这个假说如果成立,暗示了一个更一般的架构设计原则:在需要信息聚合/压缩的模块使用 SSM,在需要信息检索/精确访问的模块使用 Attention。这与 hybrid architecture 的经验一致,但 H-Net 给出了更清晰的机制解释。

对之前探索的联系

- 与近视性四层分析的关系:H-Net 直接解决了预处理层的近视性(BPE → dynamic chunking),且通过 2-stage 间接缓解了其他层面的问题(更好的表示 → 更少的信息丢失)。

- 与残差连接信息稀释的关系:H-Net 使用了 network normalization(每个子网络末尾加 RMSNorm)来解决 hierarchical 架构中的 norm 不平衡问题。这是 AttnRes/DCA 解决的问题的一个特例。

- 信息压缩作为归纳偏置:Mamba 在 encoder 中的优势(压缩导向)与之前关于 SSM vs Attention 的讨论形成呼应。不是"谁更好"的问题,而是"在哪个位置谁更合适"的问题。

关键引用

- Hwang, Wang, Gu (2025). Dynamic Chunking for End-to-End Hierarchical Sequence Modeling. [ref]

- Gu et al. (2024). Mamba-2: Structured State Space Duality. [ref]

- Shih, Sadigh, Ermon (2023). Long Horizon Temperature Scaling. [ref]

最后更新: 2026-03-19 18:50